Искусственный интеллект требует все новых вычислительных ресурсов, Яндексу, Сберу, ВК, МТС нужно больше видеокарт — Ъ

Российские технологические компании, работающие над проектами в области машинного обучения, в 2023–2024 годах вслед за мировым рынком стали активнее коммерциализировать. Так, «Яндекс» и Сбербанк не только интегрировали большие языковые модели (LLM) YandexGPT и GigaChat в свои ассистенты, но и позволили компаниям обращаться к ним за обработкой или генерацией контента. Продукты и функции на базе генеративного ИИ, использующие собственные LLM, также представили VK и МТС.

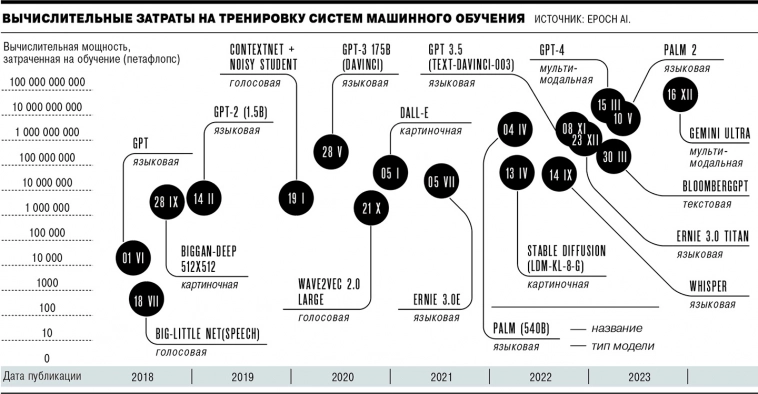

Создание LLM требует значительных вычислительных мощностей. Чем больше у модели параметров, тем выше ее способности и число операций, предпринимаемых для ее тренировки. Само по себе обращение к нейросетям, прошедшим тренировку, также расходует ресурсы. По словам директора бизнес-группы поиска и рекламных технологий «Яндекса» Дмитрия Масюка, стоимость ответов на основе YandexGPT в пересчете на пользователя в семь раз выше, чем при использовании классических технологий.

В работе с ИИ важную роль играют графические ускорители (видеокарты). Исходно они использовались только для задач, связанных с компьютерной графикой: видеоигр, 3D-моделирования и рендеринга и т. п. Однако в 2006 году американский производитель Nvidia дал разработчикам возможность применять видеокарты для вычислений общего характера. Устройства одновременно производят множество алгебраических вычислений, что важно для ИИ-задач. По итогам 2023 года на серверные графические ускорители Nvidia приходится 97% всей выручки, которую приносит сегмент во всем мире, следует из исследования Dell’Oro Group.

www.kommersant.ru/doc/6731112